WhatsAppは、児童ポルノの写真やビデオの交換を専門とする約10のプライベートグループに悩まされていることがイスラエルの調査で明らかになった。研究者らによると、インスタントメッセージングアプリケーションには、こうした画像の拡散を阻止するための人間のモデレーターが深刻に不足しているという。

イスラエルのNGO2団体からの報告書によると、我々の同僚が伝えた。テッククランチ、サードパーティのアプリケーションは WhatsApp グループを使用して交換します児童ポルノの画像。調査の結果、TechCrunchは、犯罪者グループが残念ながら今も活動していることを保証する。

WhatsAppグループが児童ポルノを共有、2つのNGOを告発

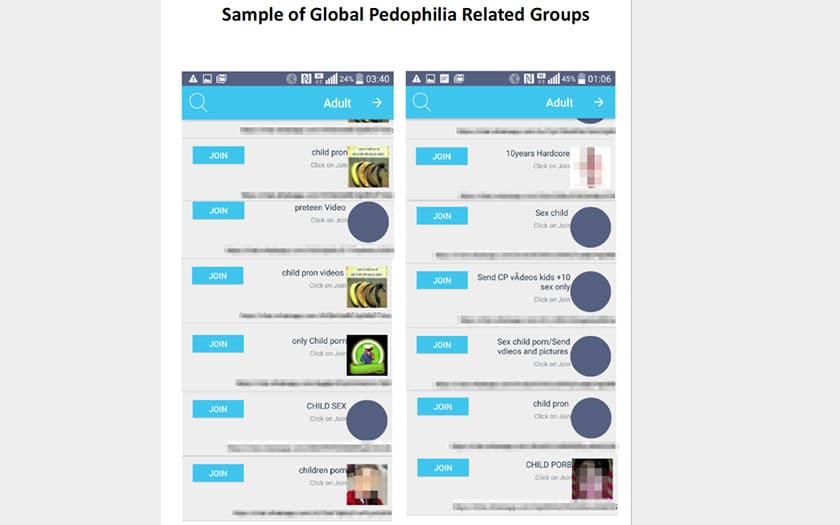

報告書が特に指摘しているのは、サードパーティ製アプリケーション「Group Links For Whats」によって中継されるグループリサスタジオ著。このアプリケーションでは、児童ポルノグループは実際のコンテンツをわざわざ隠そうともしません。したがって、「児童ポルノ xvideos」や「児童ポルノのみ、adv なし」などのタイトルが見つかります。

他のケースでは、児童ポルノ製作者は単に自分の意図を隠しているだけです。「児童ポルノ」の略語「cp」、未成年者の搾取と戦う新興企業AntiToxinが報じている。この驚くべき透明性にもかかわらず、WhatsApp は依然として問題のグループを禁止していません。現在、合計 1,300 件の児童ポルノの画像とビデオが、約 10 のグループを通じてメッセージング アプリケーション上で何の処罰も受けずに出回っています。

こちらもお読みください:WhatsAppで発見された児童ポルノネットワークは解体された

NGO の報告書によると、WhatsApp は世界中の 15 億人のアクティブ ユーザーのコミュニティを管理するのに十分な人間のモデレーターを雇用していません。親会社であるFacebookから半独立しているWhatsAppは実際にはカウントされない300 人の従業員がコンテンツ管理に専念していること。比較のために、Facebook は最近モデレーターの数を 10,000 人から 20,000 人に増やしました。より多くのリソースがあれば、同社はこれらの共有グループの存在を簡単に検出できたであろうとNGOは推定している。 TechCrunchから連絡がありました。WhatsAppは、10日間で13万のアカウントを禁止したと今でも説明している。

「WhatsApp は児童の性的虐待に対してゼロ・トレランス・ポリシーを持っています。当社は、人工知能を含む最先端のテクノロジーを導入して、報告されたコンテンツ内の写真やプロフィール写真をスキャンし、このコンテンツを共有している疑いのあるアカウントを積極的に禁止します。また、私たちは世界中の法執行機関の要請に対応し、あらゆる虐待を直ちに国立行方不明児童・搾取児童センターに報告します。」メッセージングサービスを提供します。

![[Résolu] リカバリは SEANDROID を強制するものではありません](https://yumie.trade/statics/image/placeholder.png)